Che cos'è Kubernetes?

Scoprite la conoscenza completa del sistema Kubernetes, il suo funzionamento e i vantaggi per le vostre applicazioni aziendali.

Siete alla ricerca di un sistema di gestione operativa automatica per le vostre applicazioni? Se sì, Kubernetes può essere la vostra scelta e, combinato con AppMasteraiuterà l'hosting delle applicazioni utilizzando una no-code piattaforma e Kubernetes caratteristiche. Ma prima, è essenziale sapere che cos'è Kubernetes è, come la sua trasformazione digitale è significativa e come funziona.

Kubernetes è anche indicato come forma abbreviata K8s o Kube. In definitiva, aiuta nell'automazione dell'applicazione e ogni comando presente all'interno delle applicazioni in distribuzione, come procedere con le modifiche e scalare i parametri in base alla trasformazione digitale, richiede esigenze, tenere d'occhio lo stato di salute dell'applicazione e quant'altro, diventa più facile con il sistema di distribuzione. Kubernetes. Inoltre, Kubernetes è un software open-source di automazione delle applicazioni per la distribuzione e la gestione. Grazie alla loro affidabilità e alle loro disposizioni, i container sono spesso utilizzati per costruire applicazioni moderne.

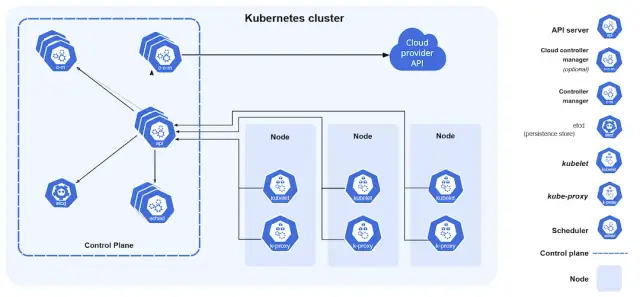

Cosa sono i Kubernetes cluster?

Un gruppo di dispositivi di nodi gestiti per gestire applicazioni containerizzate in scala, noti anche come Kubernetes cluster. A Kubernetes cluster deve contenere un piano di controllo e uno o più nodi, che sono dispositivi di elaborazione. Il piano di controllo deve poi supportare la forma preferita del cluster, comprese le applicazioni aziendali attive e le immagini dei container che utilizzano. I nodi gestiscono i carichi di lavoro e le app aziendali o le applicazioni containerizzate.

La capacità di organizzare e gestire i container in un insieme di computer può essere costituita da macchine virtuali, cioè nel cloud, o fisiche, cioè in sede; entrambe sono alla base dei vantaggi di Kubernetes. I contenitori in Kubernetes non sono legati a dispositivi specifici. Sono in qualche modo separati in tutto il cluster.

Chi contribuisce a Kubernetes?

Gli ingegneri di Google hanno creato e sviluppato inizialmente Kubernetes. Google ha discusso apertamente il modo in cui tutto viene eseguito nei container all'interno dell'azienda ed è stato uno dei pionieri nello sviluppo della tecnologia dei container Linux. (Questa tecnologia è alla base delle offerte di cloud-build di Google).

La piattaforma interna di Google, Borg, alimenta oltre 2 miliardi di implementazioni di container ogni settimana. La trasformazione digitale e l'innovazione che stanno alla base di gran parte di Kubernetes sono state sviluppate utilizzando le lezioni apprese durante la costruzione di Borg, il precursore di Kubernetes.

Cosa si può fare con Kubernetes?

È possibile fare numerose cose con il sistema Kubernetes che spingono l'impossibile da gestire ed essere una trasformazione digitale e un'innovazione digitale per Kubernetes I cluster funzionano in modo automatico, orchestrano i container tra numerosi utenti e ottimizzano l'utilizzo dell'aiuto costruendo un uso più accettabile dell'infrastruttura e dell'interfaccia.

Rollout e rollback

Kubernetes deployment consente di distribuire gradualmente le modifiche alla configurazione o al codice dell'applicazione, tenendo traccia dello stato di salute dell'applicazione per evitare la chiusura di massa delle istanze. Kubernetes Il deployment ripristina le modifiche se si verifica qualcosa di impreciso. Approfittate dell'ecosistema in espansione delle strategie di distribuzione.

Bilanciamento del carico

Non è necessario modificare l'applicazione per utilizzare un meccanismo di scoperta dei servizi sconosciuto. Ai pod vengono assegnati indirizzi IP unici da Kubernetespermettendo il bilanciamento del carico su un gruppo di Pod sotto un unico nome DNS.

Orchestrazione dei depositi

Ascende automaticamente al sistema di repository che si preferisce, sia esso un deposito provinciale, una tecnica di archiviazione web come iSCSI, Cinder, NFS, o Ceph o un fornitore di build cloud generale come AWS.

Sorveglianza della configurazione

Distribuire e correggere enigmi, disposizione delle applicazioni e formattazione senza ricostruire l'immagine o rivelare i segreti della composizione dello stack.

Imballaggio dei contenitori

Posiziona automaticamente i container mantenendo la disponibilità in base alle esigenze di risorse e ad altri vincoli. Combinate carichi di lavoro critici e best-effort per aumentare l'utilizzo e risparmiare ancora più risorse.

Esecuzione in batch

Kubernetes è in grado di gestire i carichi di lavoro dell'insieme di container e di CI e di fornire assistenza, restituendo i container falliti, se necessario.

Scalabilità orizzontale

È possibile scalare rapidamente l'applicazione verso l'alto o verso il basso utilizzando un comando, l'interfaccia utente o automaticamente in base all'utilizzo di CPU.

Autoguarigione

Uccide i container che non rispondono al controllo dello stato di salute definito dall'utente, riavvia i container falliti, sostituisce e riprogramma i container quando i nodi muoiono e non pubblicizza i container ai client finché non sono pronti a servire.

Progettato per l'estensibilità

Grazie alla sua elevata estensibilità, è possibile aggiungere funzionalità al cluster Kubernetes senza modificare il codice sorgente upstream.

IPv4 e IPv6 dual-stack

Emissione di pod o servizi come gli indirizzi IPv4 e IPv6.

Come funziona Kubernetes funziona?

Il Kubernetes cluster è una configurazione Kubernetes funzionale. Il piano di controllo e i nodi di calcolo, o machine learning, possono essere visti come i due componenti distinti di un cluster. Kubernetes cluster. Ogni nodo, che può essere un sistema fisico o virtuale, ha il proprio ambiente Linux. I pod, che sono composti da container, vengono eseguiti da ogni nodo. Il piano di controllo deve mantenere lo stato desiderato del cluster, comprese le applicazioni attive e le immagini dei container che utilizzano. Le applicazioni e i carichi di lavoro containerizzati vengono eseguiti su un sistema di apprendimento automatico.

Sistema operativo (come Enterprise Linux) che Kubernetes viene eseguito su di esso. Comunica con i pod di container in esecuzione sui nodi. Il Kubernetes piano di controllo invia i comandi all'apprendimento automatico dell'elaborazione dopo averli ricevuti da un amministratore (o da un team). DevOps team). Questo handoff utilizza una serie di servizi per determinare automaticamente il nodo più appropriato per l'attività. L'attività desiderata viene successivamente assegnata ai pod del nodo quando vengono assegnate le risorse.

Lo stato desiderato di un Kubernetes cluster specifica quali carichi di lavoro o applicazioni dovrebbero essere in esecuzione insieme alle immagini che dovrebbero utilizzare, alle risorse a cui dovrebbero accedere e ad altre informazioni di configurazione simili. Non è cambiato molto in termini di infrastruttura quando si tratta di gestire i container. In poche parole, si ha un maggiore controllo sui container, poiché si possono gestire le app a un livello superiore senza gestire ogni singolo container o nodo.

L'utente è responsabile della definizione dei nodi, dei pod e dei container di Kubernetes che risiedono al loro interno. I contenitori sono orchestrati utilizzando Kubernetes. Dipende da dove si esegue Kubernetes. Questo può essere fatto su server fisici, machine learning virtuali, cloud pubblici, cloud privati e cloud ibridi. Il fatto che Kubernetes API funziona su diversi tipi di infrastruttura è uno dei suoi principali vantaggi.

È Kubernetes uguale a Docker?

Esiste un insieme di strumenti di sviluppo software chiamati Docker per costruire, condividere ed eseguire singoli container. Kubernetes è una soluzione per implementare applicazioni containerizzate su scala. Consideriamo i container come un packaging standardizzato per i microservizi che contiene tutte le dipendenze e il codice applicativo necessari. Docker è responsabile della costruzione di queste applicazioni containerizzate. Un container può essere eseguito ovunque, compresi i server locali, le tecnologie cloud-native ibride, i laptop e persino i dispositivi edge.

Nelle applicazioni moderne sono presenti numerosi container. Kubernetes API è incaricata di eseguirli nella produzione effettiva. Le applicazioni containerizzate possono scalare automaticamente, espandendo o riducendo le capacità di elaborazione per soddisfare le richieste degli utenti, perché la replica dei container è semplice. La maggior parte delle volte, Kubernetes e Docker sono tecnologie complementari. Tuttavia, Docker offre anche una soluzione nota come Docker Swarm - Kubernetes vs DockerSwarm - per l'esecuzione di applicazioni containerizzate su larga scala.

Che cos'è l'infrastruttura nativa di Kubernetes?

L'insieme delle risorse (tra cui server, machine learning reali o virtuali, piattaforme ibride cloud-native e altro) che costituiscono la base di un ambiente Kubernetes ambiente è noto come Kubernetes infrastruttura. Il processo di automazione di molte operazioni operative necessarie per la vita di un container, dal deployment al ritiro, è noto come orchestrazione dei container. Una piattaforma open-source molto apprezzata a questo scopo è Kubernetes.

Sotto il cofano, l'infrastruttura e l'architettura di Kubernetes si basano sull'idea di un cluster, che è un insieme di computer, chiamato in questo linguaggio "nodes". Kubernetes L'API consente di distribuire carichi di lavoro containerizzati sul cluster. I nodi sono i computer che eseguono i carichi di lavoro containerizzati, che possono essere macchine reali o virtuali. Anche se un cluster spesso ha più o più nodi worker, ogni cluster contiene un nodo controller e un nodo Kubernetes ogni cluster contiene un nodo controller e almeno uno di questi nodi worker.

Il "pod" è un'altra nozione cruciale Kubernetes secondo la documentazione ufficiale, è la più piccola unità distribuibile e viene eseguita sui nodi del cluster. In altre parole, i pod rappresentano le varie parti dell'applicazione. Sebbene possa occasionalmente eseguire più di un contenitore, un pod in genere ne esegue solo uno.

Il piano di controllo è un altro componente essenziale dell'architettura del cluster. Kubernetes architettura del cluster. È costituito dal server API e da quattro elementi aggiuntivi che gestiscono in modo efficiente le applicazioni e i nodi (o macchine) in base allo stato necessario.

Quali sono i vantaggi dell'infrastruttura Kubernetes-native?

I vantaggi dell'infrastruttura Kubernetes nativa, alcuni dei quali sono elencati di seguito.

- Agilità

Agilità e semplicità delle tecnologie native del cloud pubblico e ibrido on-premises per ridurre il conflitto tra operazioni IT e produttività degli sviluppatori.

- Efficienza dei costi

È possibile risparmiare molto denaro e rendere la propria attività il più possibile efficiente dal punto di vista dei costi. Si risparmia perché non è necessario un livello di hypervisor separato per eseguire VMs.

- Flessibilità

L'impresa Kubernetes consente la produttività degli sviluppatori per distribuire container, app aziendali serverless e VMs, scalando le applicazioni e l'infrastruttura che le rende più flessibili.

- Estensibilità

L'estensibilità del cloud ibrido nativo utilizzando Kubernetes come livello di base per i cloud pubblici e privati lo rende il più estensibile.

Perché è necessario Kubernetes?

È possibile distribuire e gestire applicazioni containerizzate, legacy, cloud-native e aziendali che vengono rielaborate in microservizi con l'ausilio di Kubernetes. Il team di sviluppo delle app deve essere in grado di sviluppare rapidamente nuove applicazioni e servizi per soddisfare le mutevoli esigenze aziendali. Partendo da microservizi in container, lo sviluppo di app cloud-native consente di velocizzare lo sviluppo delle app e di semplificare la conversione e l'ottimizzazione dei programmi esistenti. È necessario utilizzare più host server per distribuire i container che costituiscono le app aziendali di produzione. Gli strumenti di orchestrazione e di gestione sono disponibili con Kubernetes per distribuire i container per questi carichi di lavoro su scala.

Caso d'uso in tempo reale

Supponiamo che abbiate creato uno strumento per la trasformazione digitale e lo shopping online. E che si intenda utilizzare un Docker container per distribuire questa applicazione. Avete creato un'immagine Docker immagine per l'applicazione e si è distribuita l'immagine come un Docker contenitore. Tutto funziona senza problemi. Grazie alla crescente popolarità dell'applicazione, la base di clienti è aumentata. A causa dell'elevata richiesta dell'applicazione, il server si blocca. In questo momento, avete pianificato una configurazione cluster. Quindi, avete prodotto cinque (5) istanze dell'applicazione utilizzando Docker su un singolo computer. Il server può gestire facilmente il traffico ora che il carico è stato distribuito. Ancora una volta, più persone utilizzano la vostra applicazione. Un computer non può supportare cinque istanze contemporaneamente. Si intende aggiungere altri computer al cluster di Docker cluster di container. Il vero problema sorge proprio qui.

- Su un singolo computer, Docker i contenitori possono comunicare facilmente. Tuttavia, non può replicarsi su più computer.

- La replica richiede un certo sforzo. Per creare un'istanza N, dobbiamo rielaborarla.

- Docker non è in grado di determinare se un contenitore attivo è andato in crash.

- Dobbiamo riavviare il contenitore se uno si blocca manualmente. Non è in grado di auto-ripararsi.

Come già detto, per risolvere il problema è necessaria una soluzione di orchestrazione dei container. Kubernetes è che. Gli strumenti per l'orchestrazione dei container sono numerosi. Ma molti sviluppatori usano Kubernetes. Un'applicazione per i cluster è Kubernetes. Simile ai nodi master e secondari. I nodi worker eseguiranno Docker contenitori. Un nodo controllore conserva i meta-dati sui container attualmente in funzione. Docker contenitori attualmente in funzione.

Kubernetes e DevOps

I team di sviluppo e di gestione delle applicazioni sono combinati in un unico gruppo attraverso la tecnica di sviluppo del software nota come DevOps. Una tecnologia di orchestrazione open-source chiamata Kubernetes è stata creata per aiutarvi a gestire le distribuzioni di container su scala. Tuttavia, esiste un legame tra Kubernetes e DevOps.

Punti principali

Kubernetes è eccellente per lo sviluppo, la distribuzione e l'espansione di app e pipeline aziendali, grazie alle sue caratteristiche e capacità. DevOps pipeline aziendali, grazie alle sue caratteristiche e capacità. Grazie a queste funzionalità, i team possono automatizzare il lavoro manuale che l'orchestrazione richiede. I team hanno bisogno di questa automazione per aumentare la produzione e, soprattutto, la qualità.

È possibile costruire l'intera infrastruttura con Kubernetes. Kubernetes può accedere agli strumenti e alle applicazioni, compresi i database, le porte e i controlli di accesso. Anche le configurazioni dell'ambiente possono essere gestite come codice. Quando si distribuisce un nuovo ambiente, non è sempre necessario eseguire uno script, ma si può dare a Kubernetes un repository sorgente contenente i file di configurazione.

Quando si orchestra la pipeline con Kubernetesè possibile gestire controlli a grana fine. Ciò consente di limitare la capacità di ruoli specifici o di applicazioni di svolgere particolari attività. Ad esempio, si possono limitare i tester alle build e i clienti ai processi di distribuzione o di revisione.

Gli sviluppatori possono costruire l'infrastruttura su richiesta con la funzionalità di catalogo self-service di Kubernetes. Questo copre i servizi di costruzione del cloud resi disponibili attraverso gli standard dei servizi aperti e dei server API, come le risorse. AWS risorse. Questi servizi sono basati sulle impostazioni che i membri delle operazioni sono autorizzati a usare, il che aiuta a mantenere la sicurezza e la compatibilità.

È possibile distribuire nuove release di Kubernetes risorse senza alcun tempo di inattività, grazie alle funzioni di rollback automatico e di aggiornamento continuo. È possibile utilizzare Kubernetes per distribuire il traffico tra i servizi accessibili, aggiornando un cluster alla volta invece di dover chiudere gli ambienti di produzione e distribuire nuovamente quelli aggiornati. Grazie a queste funzioni è possibile completare in modo efficiente le distribuzioni blue/green. Inoltre, è possibile eseguire test A/B per assicurarsi che le funzionalità del prodotto siano desiderate e dare priorità alle nuove funzionalità dei clienti in modo più rapido. In conclusione, Kubernetes e DevOps non sono perfetti, ma Kubernetes possono essere uno strumento molto efficace con una configurazione adeguata. Basta fare attenzione a non farsi coinvolgere troppo e a capire che K8s non è una soluzione universale.

AppMaster e Kubernetes

AppMaster è una no-code piattaforma che consente lo sviluppo di applicazioni e di tutti i tipi di applicazioni. Aiuta a ospitare le applicazioni degli utenti in Kubernetesche renderà le applicazioni aziendali e la gestione di queste applicazioni più semplice e migliore.

La linea di fondo

Poiché Kubernetes è open source, non esiste un sistema di supporto consolidato, almeno non uno su cui la vostra azienda possa contare. Probabilmente ci si sentirebbe infastiditi se si verificasse un problema con la configurazione Kubernetes quando viene utilizzato in produzione.

Immaginate Kubernetes come il motore di un'automobile. Sebbene un motore possa funzionare in modo indipendente, diventa parte di un veicolo funzionante solo quando viene accoppiato a una trasmissione, agli assi e alle ruote. Installare Kubernetes per creare una piattaforma adatta alla produzione è insufficiente. Perché Kubernetes per funzionare al massimo delle sue potenzialità, sono necessarie altre parti. È necessario aggiungere strumenti per il networking, la sicurezza, il monitoraggio, la gestione dei log e l'autenticazione.

È qui che entra in gioco AppMaster, l'intera macchina. Kubernetes per le aziende è AppMaster. Incorpora tutte le diverse tecnologie, tra cui registro, rete, telemetria, sicurezza, automazione e servizi, che rendono il sistema solido e pratico per l'ambiente di lavoro. Kubernetes solido e pratico per l'ambiente di lavoro.

I vostri sviluppatori possono creare nuove applicazioni web ed enterprise da zero, ospitarle e distribuirle nel cloud-native con la scalabilità, l'autorità e l'orchestrazione necessarie per trasformare rapidamente una buona idea in un nuovo business. Tutto questo è possibile grazie alla AppMaster.

Utilizzando le più recenti no-code tecnologia e drag-and-drop interfaccia di runtime per container con un backend robusto, si può provare a usare AppMaster per automatizzare le operazioni del container con il progetto Kubernetes e creare la vostra applicazione mobile o web da zero.