Utilisation de Docker pour l'architecture microservices

Explorer les avantages de l'utilisation de Docker dans une architecture microservices, y compris les stratégies de conteneurisation et de déploiement, afin d'accélérer le développement d'applications et d'améliorer l'évolutivité.

Docker et les microservices

L'architecture microservices est devenue de plus en plus populaire ces dernières années, car elle offre des avantages significatifs en termes d'évolutivité, de flexibilité et de maintenance pour les applications logicielles. À la base, les microservices sont un modèle architectural dans lequel une application unique est composée d'une collection de petits services indépendants, chacun responsable d'une fonctionnalité spécifique et communiquant les uns avec les autres par le biais d' API. Cette modularité permet un développement et un déploiement rapides, des tests plus faciles et une mise à l'échelle pratique des applications.

Dans ce contexte, Docker apparaît comme un outil puissant pour travailler avec des microservices. Docker est une plateforme open-source qui facilite le développement, le déploiement et la gestion des applications par le biais de la conteneurisation. Elle permet aux développeurs d'empaqueter les applications et leurs dépendances dans des conteneurs légers et portables, ce qui garantit que les applications fonctionnent de manière cohérente dans différents environnements et à différents stades de développement. En s'appuyant sur Docker, les développeurs peuvent rationaliser efficacement le processus de création, de gestion et de mise à l'échelle des microservices.

Pourquoi utiliser Docker pour l'architecture microservices ?

Docker et les microservices s'accordent naturellement pour plusieurs raisons essentielles.

Environnement normalisé

Docker permet aux développeurs de créer un environnement d'application standardisé en conditionnant tous les composants nécessaires, y compris l'application elle-même, les bibliothèques et les dépendances, dans une unité unique et autonome appelée conteneur. Cette normalisation réduit le risque d'incohérences environnementales qui peuvent survenir entre les environnements de développement, de staging et de production, garantissant ainsi que les microservices se comportent toujours comme prévu.

Développement accéléré

L'utilisation de conteneurs Docker accélère considérablement les processus de développement des microservices. Chaque conteneur étant un environnement isolé, les développeurs peuvent travailler sur des services individuels sans se soucier des dépendances ou des bibliothèques conflictuelles. En outre, les images Docker peuvent être facilement partagées entre les membres de l'équipe, ce qui leur permet de déployer et d'exécuter rapidement des applications sur leurs machines locales, accélérant ainsi le développement et la collaboration.

Portabilité améliorée

Les conteneurs créés avec Docker sont hautement portables, ce qui permet aux développeurs de déplacer facilement les applications entre différents environnements et plateformes. Cette portabilité garantit que les microservices peuvent être déployés et exécutés de manière cohérente sur différents systèmes, quelle que soit l'infrastructure sous-jacente. Par conséquent, les équipes de développement peuvent se concentrer sur la création des meilleures applications possibles sans se soucier des nuances propres à chaque système.

Réduction de l'utilisation des ressources du système

L'architecture microservices peut potentiellement entraîner une augmentation de la consommation de ressources, car chaque service peut s'exécuter sur des machines distinctes, ce qui entraîne des frais généraux sur les ressources système. Docker résout ce problème en créant des conteneurs légers qui partagent les ressources sous-jacentes du système hôte, réduisant ainsi la consommation globale de ressources par rapport à l'exécution de plusieurs machines virtuelles.

Gestion simplifiée des microservices

Docker simplifie la gestion et la surveillance des microservices en fournissant un environnement cohérent pour le déploiement et l'exécution des conteneurs. Les développeurs peuvent utiliser des outils tels que Docker Compose pour définir l'ensemble de la pile d'applications, y compris les microservices individuels et leurs dépendances, ce qui facilite le déploiement et la gestion cohérente des services.

Conteneurisation des microservices avec Docker

La conteneurisation des microservices avec Docker implique la création d'un fichier Docker contenant des instructions pour la construction d'une image Docker. Cette section vous guidera à travers le processus de conteneurisation d'un exemple de microservice à l'aide de Docker.

Créer un Dockerfile

Un Dockerfile est un script contenant des instructions pour construire une image Docker. Le Dockerfile définit l'image de base, le code source de l'application, les dépendances et les configurations nécessaires à l'exécution du service. Créez un nouveau fichier nommé `Dockerfile` dans le répertoire racine de votre microservice.

Définir l'image de base

Spécifiez l'image de base pour votre microservice en ajoutant la commande `FROM` à votre Dockerfile. L'image de base est la fondation de votre conteneur, fournissant l'environnement d'exécution nécessaire. Le choix d'une image de base appropriée pour votre microservice est essentiel, comme une image officielle et minimale fournie par Docker ou une image personnalisée adaptée à vos besoins. Par exemple, si votre microservice est développé en Node.js, vous pouvez utiliser la ligne suivante dans votre Dockerfile :

FROM node:14

Définir le répertoire de travail

Définissez le répertoire de travail du conteneur en utilisant la commande `WORKDIR`. Ce répertoire sera utilisé pour stocker le code source et les dépendances de l'application.

WORKDIR /app

Copier le code source et les dépendances

Copiez le code source et tous les fichiers nécessaires de la machine locale vers le conteneur en utilisant la commande `COPY`. De plus, installez les dépendances nécessaires en utilisant des gestionnaires de paquets tels que npm, pip, ou Maven.

COPY package*.json ./ RUN npm install COPY . .

Exposer le port de service

Exposez le port sur lequel le microservice sera accessible en utilisant la commande `EXPOSE`. Cela permettra la communication avec le microservice depuis d'autres conteneurs ou services externes.

EXPOSE 8080

Exécuter l'application

Démarrez le microservice en utilisant la commande `CMD`, en spécifiant la commande requise pour exécuter l'application.

CMD ["npm", "start"]

Après avoir créé le fichier Docker, construisez l'image Docker en exécutant la commande suivante dans le même répertoire que le fichier Docker :

docker build -t your-image-name .

Enfin, exécutez le conteneur Docker en utilisant l'image nouvellement créée :

docker run -p 8080:8080 nom-de-votre-image

Votre microservice est maintenant conteneurisé et fonctionne dans un conteneur Docker. Ce processus peut être répété pour chaque microservice de votre application, ce qui vous permet de développer, tester et déployer vos microservices d'une manière rationalisée, efficace et cohérente.

Déploiement et orchestration des conteneurs Docker

Le déploiement et l'orchestration des conteneurs Docker sont des éléments essentiels de la gestion des architectures de microservices. Les outils d'orchestration de conteneurs automatisent le déploiement, la gestion et la mise à l'échelle des conteneurs individuels, garantissant ainsi que les microservices fonctionnent ensemble de manière efficace. Kubernetes et Docker Swarm sont deux plateformes d'orchestration de conteneurs très répandues.

Kubernetes

Kubernetes est une plateforme d'orchestration de conteneurs open-source qui automatise le déploiement, la mise à l'échelle et la gestion des applications conteneurisées. Elle est largement adoptée en raison de ses puissantes fonctionnalités et de son puissant écosystème. Voici quelques-uns des principaux avantages de Kubernetes :

- Évolutivité : Kubernetes utilise une configuration déclarative pour gérer la mise à l'échelle des conteneurs, ce qui facilite la mise à l'échelle des applications en fonction de la demande.

- Haute disponibilité : Kubernetes assure une haute disponibilité en répartissant les conteneurs sur différents nœuds et en gérant automatiquement le redémarrage des conteneurs en cas de défaillance.

- Équilibrage de la charge : Kubernetes peut équilibrer les demandes entre plusieurs instances d'un microservice, améliorant ainsi les performances et la tolérance aux pannes.

- Journalisation et surveillance : Kubernetes s'intègre à divers outils de journalisation et de surveillance, ce qui simplifie le suivi de la santé et des performances des applications.

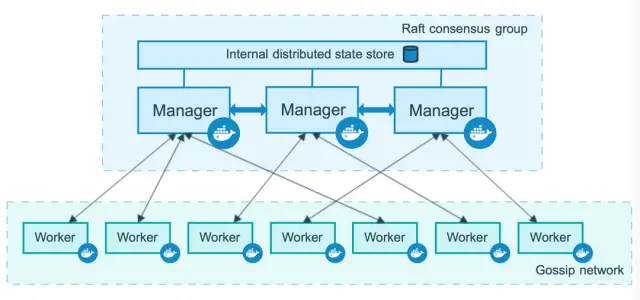

Docker Swarm

Docker Swarm est une solution native de clustering et d'orchestration pour les conteneurs Docker. Elle est intégrée directement dans la plateforme Docker, ce qui en fait un choix simple et intuitif pour les utilisateurs de Docker. Docker Swarm offre les avantages suivants :

- Facilité d'installation : Docker Swarm ne nécessite pas d'installation ou de configuration approfondie. Il fonctionne de manière transparente avec la CLI et l'API de Docker, ce qui simplifie le déploiement et la gestion des conteneurs.

- Mise à l'échelle : Docker Swarm permet aux utilisateurs de faire évoluer les services rapidement et efficacement en ajustant le nombre de répliques de conteneurs pour chaque service.

- Équilibrage de la charge : Docker Swarm répartit automatiquement les demandes entre les conteneurs, améliorant ainsi les performances et la résilience des applications.

- Découverte des services : Docker Swarm inclut un serveur DNS intégré pour la découverte de services, ce qui permet aux conteneurs de se découvrir et de communiquer entre eux.

Source de l'image : Docker Docs

Kubernetes et Docker Swarm sont tous deux des outils d'orchestration populaires pour la gestion des conteneurs Docker dans les architectures microservices. Le choix de l'outil approprié dépend des exigences spécifiques de votre application ainsi que de l'infrastructure existante et de l'expertise de l'équipe.

Création d'une application microservices Dockerisée

Passons en revue les étapes de la création d'une application de microservices Dockerisée :

- Concevoir des microservices : Décomposez votre application en plusieurs petits services modulaires qui peuvent être développés, déployés et mis à l'échelle de manière indépendante. Chaque microservice doit avoir une responsabilité bien définie et communiquer avec les autres via des API ou des files d'attente de messagerie.

- Créer des fichiers Docker : Pour chaque microservice, créez un fichier Docker qui spécifie l'image de base, le code de l'application, les dépendances et la configuration nécessaires pour construire une image Docker. Cette image est utilisée pour déployer les microservices en tant que conteneurs.

- Construire des images Docker : Exécutez la commande Docker build pour créer des images Docker pour chaque microservice, en suivant les instructions définies dans les Dockerfiles correspondants.

- Créer un réseau : Établissez un réseau entre les conteneurs pour permettre la communication entre les microservices. La mise en réseau peut être réalisée à l'aide de Docker Compose ou d'un outil d'orchestration de conteneurs comme Kubernetes ou Docker Swarm.

- Configurer l'équilibrage de charge : Configurez un équilibreur de charge pour répartir les demandes entre les instances de microservices, en garantissant des performances optimales et une tolérance aux pannes. Utilisez des outils tels que Kubernetes Ingress ou l'équilibrage de charge intégré de Docker Swarm.

- Déployez des microservices : Déployez vos microservices sous forme de conteneurs Docker à l'aide de la plateforme d'orchestration de conteneurs de votre choix. Vous créerez ainsi un environnement dans lequel les microservices pourront s'exécuter, communiquer entre eux et évoluer à la demande.

Une fois toutes ces étapes terminées, l'application de microservices sera opérationnelle, chaque microservice étant déployé en tant que conteneur Docker.

Surveillance et mise à l'échelle des microservices Dockerisés

La surveillance et la mise à l'échelle sont essentielles pour garantir les performances, la fiabilité et l'efficacité d'une application de microservices Dockerisée. Voici quelques stratégies clés à prendre en compte :

Surveillance

Les outils de surveillance permettent de suivre la santé et les performances des conteneurs Docker, garantissant ainsi le fonctionnement optimal de vos microservices. Parmi les outils de surveillance les plus répandus, citons

- Prometheus: Une puissante boîte à outils open-source de surveillance et d'alerte pour les environnements conteneurisés, comprenant des intégrations avec Grafana pour la visualisation et les alertes.

- Datadog: Une plateforme d'observabilité complète qui peut agréger les métriques, les journaux et les traces des conteneurs, fournissant des informations en temps réel sur les performances de l'application.

- ELK Stack: Une combinaison d'Elasticsearch, Logstash et Kibana, utilisée pour la recherche centralisée, l'analyse et la visualisation des logs des conteneurs Docker.

Veillez à ce que votre configuration de surveillance recueille des métriques, des journaux et des données de performance pertinents afin d'identifier les problèmes potentiels et de les résoudre efficacement.

Mise à l'échelle

La mise à l'échelle des microservices Dockerisés implique d'ajuster le nombre de conteneurs exécutant chaque service pour s'adapter à des charges de travail et des demandes variables. Les plateformes d'orchestration de conteneurs telles que Kubernetes et Docker Swarm facilitent la mise à l'échelle automatique, ce qui vous permet de vous concentrer sur l'amélioration des fonctionnalités de l'application.

- Mise à l'échelle horizontale : La mise à l'échelle horizontale consiste à augmenter ou à diminuer le nombre d'instances pour chaque microservice en fonction de la demande. Pour ce faire, il suffit d'ajuster les répliques souhaitées pour chaque service dans la configuration de la plateforme d'orchestration.

- Mise à l'échelle verticale : La mise à l'échelle verticale implique l'ajustement des ressources allouées aux conteneurs individuels, telles que les limites de CPU et de mémoire. Cela garantit une utilisation optimale des ressources et peut être géré via la configuration de la plateforme d'orchestration.

En surveillant et en dimensionnant efficacement les applications microservices Dockerisées, vous pouvez maximiser l'efficacité et garantir une disponibilité, des performances et une résilience élevées.

Meilleures pratiques pour Docker et les microservices

L'utilisation de Docker dans une architecture de microservices offre de nombreux avantages, mais pour maximiser son potentiel et garantir un processus de développement et de déploiement transparent, il est essentiel de suivre certaines bonnes pratiques :

- Réduire la taille des images Docker : La réduction de la taille des images Docker permet de réduire les temps de construction et la consommation de ressources, ce qui est particulièrement important dans une architecture microservices. Utilisez des constructions en plusieurs étapes, utilisez des images de base petites et appropriées, et supprimez tous les fichiers inutiles de l'image finale.

- Architecture en couches pour les images Docker : Structurez vos images Docker à l'aide d'une architecture en couches afin d'accélérer les temps de construction. Les couches sont mises en cache par Docker pendant le processus de construction, ce qui signifie que si le contenu d'une couche n'a pas changé, elle ne sera pas reconstruite. Organisez votre fichier Docker pour tirer parti de cette fonctionnalité, en plaçant les couches fréquemment modifiées vers la fin du fichier.

- Marquage et versionnement cohérents des images : Marquez et versionnez correctement vos images pour suivre facilement les changements et revenir aux versions précédentes si nécessaire. Cela permet de maintenir la stabilité de l'application et de simplifier le dépannage.

- Mise en œuvre de la journalisation et de la surveillance : Incorporez des solutions de journalisation et de surveillance pour gérer et observer efficacement vos microservices conteneurisés. Docker fournit des pilotes de journalisation natifs, mais vous pouvez également intégrer des outils tiers conçus pour les architectures de microservices, tels que Elasticsearch, Logstash et Kibana (ELK Stack) ou Prometheus.

- Adoptez des plateformes d'orchestration de conteneurs : Utilisez des outils d'orchestration de conteneurs comme Kubernetes ou Docker Swarm pour automatiser les tâches de déploiement, de mise à l'échelle et de gestion. Ces outils gèrent des tâches complexes telles que l'équilibrage de la charge, les mises à jour en continu et la mise à l'échelle automatisée, garantissant ainsi le fonctionnement efficace de vos microservices.

- Améliorer la sécurité : Améliorez la sécurité de vos microservices conteneurisés en appliquant le principe du moindre privilège, en utilisant des images de base sécurisées et en réduisant la surface d'attaque en limitant le nombre de paquets installés. Activez la segmentation du réseau entre les services et recherchez les vulnérabilités dans vos images Docker.

- Utilisez des variables d'environnement pour la configuration : Découplez la configuration des images Docker et utilisez des variables d'environnement pour mieux séparer les préoccupations. Cela garantit qu'une seule image Docker peut être configurée différemment pour divers environnements, ce qui améliore la flexibilité et réduit la duplication.

Conclusion

L'utilisation de Docker dans une architecture microservices permet aux développeurs et aux organisations de profiter pleinement des avantages de la conteneurisation, ce qui se traduit par des applications plus agiles, plus efficaces et plus évolutives. En suivant les meilleures pratiques décrites ci-dessus, vous pouvez intégrer Docker de manière transparente dans vos processus de développement et de déploiement au sein d'une architecture microservices, transformant ainsi la manière dont vous construisez et maintenez vos applications.

De plus, l'intégration de Docker avec des plateformes no-code comme AppMaster peut vous aider à améliorer votre expérience de développement d'applications. AppMaster permet aux utilisateurs de créer visuellement des applications web, mobiles et backend, et le code source généré peut être conteneurisé et géré à l'aide de Docker pour un déploiement fluide et évolutif. La combinaison de la puissance de Docker et de AppMaster peut considérablement améliorer le processus de développement d'applications, le rendant plus efficace, plus rentable et plus rapide que jamais.

FAQ

Docker est une plateforme open-source de conteneurisation des applications, qui facilite la création et le déploiement de systèmes distribués, y compris les microservices. Elle automatise le déploiement d'applications dans des conteneurs légers et portables, ce qui facilite la collaboration et garantit la cohérence entre les environnements.

Les microservices sont un modèle d'architecture logicielle dans lequel une application unique est conçue comme une collection de petits services modulaires et déployables de manière indépendante. Chaque service exécute une fonctionnalité spécifique, communique avec d'autres services par l'intermédiaire d'API et peut être mis à jour, déployé et étendu de manière indépendante.

Docker rationalise le développement, le déploiement et la mise à l'échelle des microservices en fournissant un environnement standardisé pour la conteneurisation des applications. Cela permet d'accélérer le développement, d'améliorer la portabilité, de réduire les besoins en ressources système et de simplifier la gestion et l'orchestration des microservices.

Pour conteneuriser un microservice à l'aide de Docker, vous écrivez un Dockerfile qui contient des instructions pour construire une image Docker du service. Le fichier Docker définit l'image de base, le code source de l'application, les dépendances et les configurations. Les images Docker sont exécutées en tant que conteneurs, fournissant un environnement cohérent pour les microservices à travers les différentes étapes de développement et de déploiement.

Le déploiement et l'orchestration des conteneurs Docker peuvent être effectués à l'aide d'outils d'orchestration de conteneurs, tels que Kubernetes ou Docker Swarm. Ces outils automatisent les tâches de déploiement, de mise à l'échelle et de gestion des conteneurs, facilitant ainsi le fonctionnement transparent et efficace des microservices conteneurisés.

Voici quelques bonnes pratiques pour l'utilisation de Docker avec des microservices : 1. Réduire la taille de l'image en utilisant des images de base appropriées et en supprimant les fichiers inutiles. 2. Utiliser une architecture en couches pour les images Docker afin d'accélérer les temps de construction. 3. Appliquer un balisage et un versionnage cohérents pour les images. 4. Mettre en œuvre des solutions de journalisation et de surveillance. 5. Adopter des outils d'orchestration de conteneurs pour la gestion et la mise à l'échelle des conteneurs.

Oui, Docker peut être utilisé avec les plateformes no-code telles que AppMaster pour déployer des applications web et backend évolutives et efficaces. AppMaster permet aux utilisateurs de créer visuellement des applications et de générer du code source, qui peut être conteneurisé à l'aide de Docker pour un développement et un déploiement sans faille.

Docker simplifie la surveillance et la mise à l'échelle des microservices en permettant une intégration transparente des outils de surveillance, en offrant une meilleure utilisation des ressources et en facilitant la mise à l'échelle automatique grâce aux plateformes d'orchestration de conteneurs. Docker peut également contribuer à garantir les performances et la cohérence des applications en fournissant un environnement standardisé pour l'exécution et la gestion des microservices.