OpenAI发布GPT-4:改变文本和图像理解的多模态人工智能

OpenAI推出了GPT-4,这是一种先进的多模态人工智能,能够处理文本和图像,解锁众多使用案例。这个先进的模型现在可以提供给ChatGPT Plus的用户,并计划提供API访问。

OpenAI公布了其突破性的文本和图像理解模型GPT-4,称其为不断发展的深度学习技术的最新成功标杆。这个最新迭代的人工智能模型不仅可以处理文本,而且对图像的理解也大大超过了其前身GPT-3.5的能力。

ChatGPT Plus的用户可以使用,但有使用上限,GPT-4对1000个提示代币(约750个单词)收取0.03美元,对1000个完成代币(再次,近750个单词)收取0.06美元。我们也欢迎开发者加入等待名单来访问该API。

GPT-4因其隐蔽地集成到各种应用中而获得关注。它为微软的Bing Chat提供动力,这是一个与OpenAI合作开发的聊天机器人。其他早期采用者包括Stripe,它使用GPT-4为支持人员总结商业网站;Duolingo,它将GPT-4纳入其高级语言学习订阅;以及摩根士丹利,它利用GPT-4提取并向金融分析师提供公司文件信息。GPT-4也已被整合到可汗学院的自动辅导系统中。

与只接受文本输入的GPT-3.5相比,GPT-4同时接受文本和图像输入,在多个学术基准上表现出 "人类水平"。它超越了GPT-3.5所取得的最低10%的分数,在模拟的律师考试中取得了最高10%的分数。

在六个月的时间里,OpenAI利用内部对抗性测试项目和ChatGPT的见解完善了GPT-4,同时与微软合作设计了一台基于Azure云的超级计算机来训练高级AI模型。因此,与之前的迭代GPT-3.5相比,GPT-4在处理错综复杂的方面表现出更强的可靠性、创造性和能力。

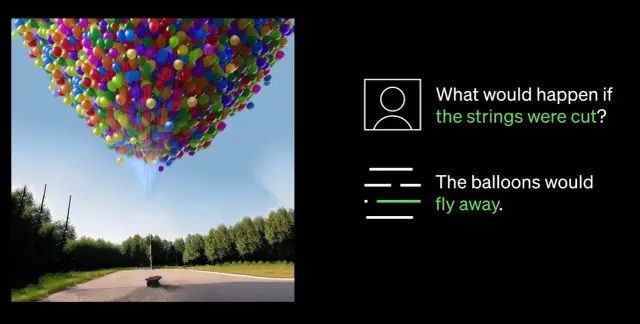

GPT-4中最值得注意的进步之一是其理解图像和文本的能力。例如,它可以解释和说明复杂的图像,如通过分析插入的iPhone图像识别Lightning Cable适配器。这种图像理解能力目前正在与单一合作伙伴Be My Eyes进行测试。他们新的由GPT-4驱动的虚拟志愿者功能通过回答有关图像的问题来协助用户,根据呈现的图像数据提供综合分析和实用建议。

GPT-4功能的一个最重要的突破是其增强的可引导性。通过新的API引入的系统信息允许开发者通过提供关于风格和任务的详细指示来引导人工智能。这些指示建立了人工智能互动的背景和边界,确保人工智能和人力资源之间的共生关系。

然而,尽管取得了实质性的进展,OpenAI承认GPT-4有局限性,包括推理错误、错误的信息,以及对2021年9月之后的事件缺乏了解。此外,GPT-4可能无意中在其产生的代码中引入漏洞。尽管如此,OpenAI在完善GPT-4方面取得了长足的进步,使其不太可能参与被禁止的内容或对敏感请求作出不适当的反应。

随着人工智能领域的不断发展,OpenAI仍然决心进一步改进GPT-4,促进由先进的人工智能技术驱动的更加智能和高效的未来。寻求在工作流程中实施人工智能的公司可以考虑探索no-code 平台,如AppMaster.io,将基于数据的决策系统纳入其业务。