OpenAI revela GPT-4: a IA multimodal que transforma a compreensão de texto e imagem

A OpenAI apresentou o GPT-4, uma IA multimodal avançada capaz de processar texto e imagens, desbloqueando inúmeros casos de utilização. O modelo avançado está agora disponível para os assinantes do ChatGPT Plus com planos de acessibilidade à API.

A OpenAI revelou o seu inovador modelo de compreensão de texto e imagem, o GPT-4, saudando-o como a mais recente referência de sucesso na evolução da tecnologia de aprendizagem profunda. Esta última iteração do modelo de IA não só processa texto, como também compreende imagens, ultrapassando significativamente as capacidades do seu antecessor, o GPT-3.5.

Acessível aos subscritores do ChatGPT Plus com um limite de utilização imposto, o GPT-4 cobra $0,03 por 1.000 tokens de prompt (cerca de 750 palavras) e $0,06 por 1.000 tokens de conclusão (mais uma vez, quase 750 palavras). Os programadores também podem juntar-se à lista de espera para aceder à API.

A GPT-4 chamou a atenção pela sua integração secreta em várias aplicações. Ela alimenta o Bing Chat da Microsoft, um chatbot desenvolvido em colaboração com a OpenAI. Outros dos primeiros utilizadores incluem a Stripe, que utiliza a GPT-4 para resumir sítios Web comerciais para o pessoal de apoio; a Duolingo, que incorpora a GPT-4 na sua subscrição de aprendizagem de línguas premium; e a Morgan Stanley, que utiliza a GPT-4 para extrair e fornecer informações sobre documentos da empresa a analistas financeiros. O GPT-4 também foi integrado no sistema de tutoria automatizado da Khan Academy.

Melhorado em relação ao GPT-3.5, que aceitava apenas texto, o GPT-4 aceita texto e imagens, demonstrando um desempenho de "nível humano" em vários parâmetros académicos. Ultrapassou as pontuações dos 10% mais baixos alcançadas pelo GPT-3.5, obtendo pontuações dentro do limiar dos 10% mais altos de um exame de ordem simulado.

Ao longo de seis meses, a OpenAI aperfeiçoou o GPT-4 utilizando conhecimentos de um programa interno de testes adversários e do ChatGPT, ao mesmo tempo que colaborava com a Microsoft na concepção de um supercomputador baseado na nuvem do Azure para treinar o modelo avançado de IA. Como resultado, o GPT-4 apresenta maior fiabilidade, criatividade e competência no tratamento de aspectos complexos em comparação com a sua iteração anterior, o GPT-3.5.

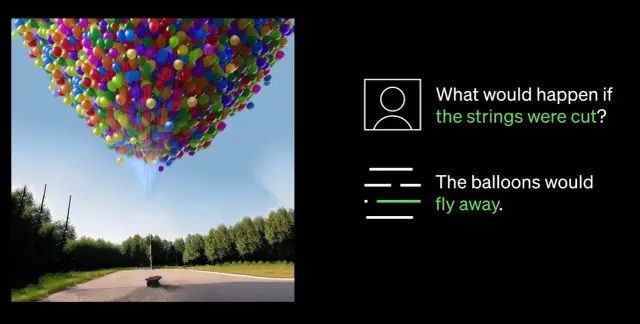

Um dos avanços mais notáveis do GPT-4 é a sua capacidade de compreender imagens e texto. Por exemplo, pode interpretar e legendar imagens complexas, como identificar um adaptador de cabo Lightning ao analisar uma imagem de um iPhone ligado à corrente. Esta capacidade de compreensão de imagens está actualmente a ser testada com o parceiro único Be My Eyes. A sua nova funcionalidade de Voluntário Virtual com GPT-4 ajuda os utilizadores a responder a perguntas sobre imagens, oferecendo uma análise abrangente e recomendações práticas com base nos dados de imagem apresentados.

Um avanço fundamental nas capacidades do GPT-4 é a sua maior capacidade de direcção. A introdução de mensagens de sistema através da nova API permite que os programadores orientem a IA fornecendo instruções detalhadas sobre o estilo e as tarefas. Estas instruções estabelecem o contexto e os limites das interacções da IA, assegurando uma relação simbiótica entre a IA e os recursos humanos.

No entanto, apesar dos avanços substanciais, a OpenAI reconhece que a GPT-4 tem limitações, incluindo erros de raciocínio, informações erradas e falta de conhecimento dos eventos após Setembro de 2021. Além disso, a GPT-4 pode inadvertidamente introduzir vulnerabilidades no código que produz. No entanto, a OpenAI tem feito progressos no aperfeiçoamento da GPT-4, tornando-a menos susceptível de se envolver em conteúdos proibidos ou de responder de forma inadequada a pedidos sensíveis.

À medida que o campo da IA continua a evoluir, a OpenAI continua determinada a melhorar ainda mais o GPT-4, promovendo um futuro mais inteligente e eficiente alimentado por tecnologia avançada de IA. As empresas que procuram implementar a IA nos seus fluxos de trabalho podem considerar explorar plataformas no-code como AppMaster.io para integrar sistemas de tomada de decisões baseados em dados nos seus negócios.