À descoberta do Auto-GPT: O futuro da automatização com os modelos da OpenAI

O Auto-GPT utiliza os modelos de IA da OpenAI para executar tarefas de forma autónoma, interagir com software e serviços online e simplificar projectos de várias etapas. Embora ofereça inúmeras vantagens, esta poderosa ferramenta também tem limitações e riscos associados à sua implementação.

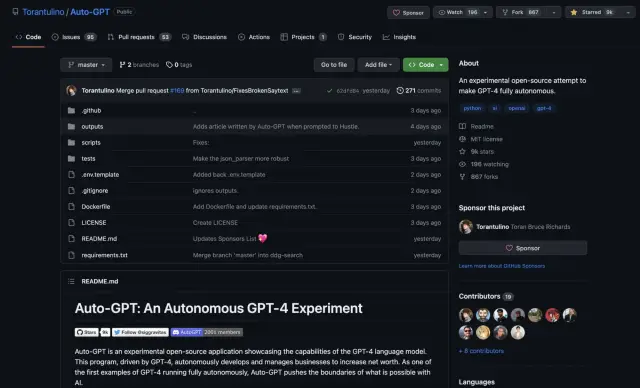

A procura contínua da automatização em Silicon Valley levou ao desenvolvimento de uma aplicação inovadora de código aberto denominada Auto-GPT, que proporciona aos utilizadores uma experiência autónoma e tira partido dos modelos avançados de IA da OpenAI, como o GPT-3.5 e o GPT-4.

A Auto-GPT cativou a atenção nas redes sociais, mostrando a sua capacidade de executar tarefas interagindo com várias aplicações, software e serviços, tanto online como localmente. A aplicação Auto-GPT, desenvolvida pelo programador de jogos Toran Bruce Richards, consegue automatizar projectos de várias etapas que exigiam uma série de interacções com modelos de IA orientados para chatbots, como o ChatGPT da OpenAI.

Ao emparelhar o GPT-3.5 e o GPT-4 com um bot companheiro, o Auto-GPT recebe instruções dos utilizadores e, subsequentemente, emprega vários programas para atingir os seus objectivos, melhorando consideravelmente o processo de automatização em diferentes plataformas.

O programador de software Joe Koen, que experimentou o Auto-GPT, explica que os utilizadores podem introduzir os seus objectivos e metas no Auto-GPT, que depois comunica com a API da OpenAI. A IA gera respostas para guiar o agente Auto-GPT através dos comandos necessários, completando as tarefas sem a intervenção do utilizador.

A funcionalidade versátil do Auto-GPT baseia-se em características como a gestão de memória para a execução de tarefas e GPT-4 e GPT-3.5 para a geração de texto, armazenamento de ficheiros e resumo. Pode até ligar-se a sintetizadores de voz, permitindo que a IA faça chamadas telefónicas, por exemplo.

No entanto, para utilizar o Auto-GPT, os utilizadores têm de o instalar num ambiente de desenvolvimento como o Docker e obter uma chave API da OpenAI, o que requer uma conta paga. Apesar disso, os primeiros utilizadores consideraram o Auto-GPT inestimável para lidar com tarefas mundanas, como depurar código, escrever e-mails ou até mesmo conceber planos de negócios para novas startups.

Adnan Masood, arquitecto-chefe da empresa de consultoria tecnológica UST, salienta que, embora os modelos linguísticos de grande dimensão sejam excelentes na geração de respostas semelhantes às humanas, também requerem contributos e interacções do utilizador para obter os resultados desejados. Em contrapartida, o Auto-GPT funciona de forma independente, tirando partido das capacidades avançadas da API da OpenAI.

Recentemente, surgiram novas aplicações como o AgentGPT e o GodMode para simplificar a utilização do Auto-GPT, fornecendo aos utilizadores uma interface acessível através de um navegador Web. No entanto, estas ferramentas continuam a necessitar de uma chave API da OpenAI para uma funcionalidade completa.

Apesar das suas poderosas capacidades, o Auto-GPT tem limitações e riscos. A ferramenta pode apresentar um comportamento imprevisível, dependendo dos objectivos fornecidos. Além disso, a sua dependência dos modelos de linguagem da OpenAI para a conclusão da tarefa significa que pode produzir imprecisões e erros. Além disso, o Auto-GPT tem dificuldade em recordar tarefas concluídas anteriormente e, muitas vezes, não se lembra dos programas adequados a utilizar para tarefas semelhantes no futuro. Também tem dificuldade em decompor tarefas complexas e em compreender objectivos sobrepostos.

Clara Shih, CEO da Service Cloud da Salesforce e entusiasta do Auto-GPT, enfatiza a importância de integrar uma abordagem humana no ciclo para empresas que empregam tecnologias de IA generativas como o Auto-GPT. Isto ajuda a mitigar os riscos e a maximizar o potencial das capacidades do Auto-GPT de uma forma segura e eficiente.

À medida que o panorama do no-code continua a expandir-se, plataformas inovadoras como o AppMaster oferecem soluções que permitem aos utilizadores criar aplicações sofisticadas de backend, web e móveis com facilidade. Tal como o Auto-GPT, o AppMaster também permite aos utilizadores desenvolver e gerir projectos, contribuindo para um fluxo de trabalho mais simplificado e eficiente em vários sectores.