OpenAI dévoile GPT-4 : l'IA multimodale qui transforme la compréhension du texte et de l'image

OpenAI a présenté GPT-4, une IA multimodale avancée capable de traiter du texte et des images, débloquant ainsi de nombreux cas d'utilisation. Le modèle avancé est maintenant disponible pour les abonnés de ChatGPT Plus avec des plans d'accessibilité à l'API.

OpenAI a dévoilé son modèle révolutionnaire de compréhension du texte et de l'image, GPT-4, le présentant comme la référence la plus récente en matière de réussite dans l'évolution de la technologie d'apprentissage profond. Cette dernière itération du modèle d'IA ne traite pas seulement le texte, mais comprend également les images, surpassant de manière significative les capacités de son prédécesseur, GPT-3.5.

Accessible aux abonnés de ChatGPT Plus avec un plafond d'utilisation imposé, GPT-4 facture 0,03 dollar pour 1 000 jetons d'invite (environ 750 mots) et 0,06 dollar pour 1 000 jetons d'achèvement (là encore, près de 750 mots). Les développeurs sont également invités à s'inscrire sur la liste d'attente pour accéder à l'API.

GPT-4 a attiré l'attention pour son intégration secrète dans diverses applications. Il alimente Bing Chat de Microsoft, un chatbot développé en collaboration avec OpenAI. Parmi les autres utilisateurs précoces, citons Stripe, qui utilise GPT-4 pour résumer des sites web commerciaux à l'intention du personnel d'assistance ; Duolingo, qui intègre GPT-4 dans son abonnement premium d'apprentissage des langues ; et Morgan Stanley, qui s'appuie sur GPT-4 pour extraire et fournir des informations sur des documents d'entreprise à des analystes financiers. Le GPT-4 a également été intégré au système de tutorat automatisé de la Khan Academy.

Amélioré par rapport au GPT-3.5, qui n'acceptait que des entrées textuelles, le GPT-4 accepte à la fois des entrées textuelles et des images, et a démontré une performance de "niveau humain" sur de nombreux critères académiques. Il a dépassé les 10 % de résultats les plus faibles obtenus par GPT-3.5 en obtenant des résultats dans le seuil des 10 % les plus élevés lors d'une simulation d'examen du barreau.

Pendant six mois, OpenAI a affiné GPT-4 en s'inspirant d'un programme interne de tests contradictoires et de ChatGPT, tout en collaborant avec Microsoft à la conception d'un superordinateur basé sur le cloud Azure pour entraîner le modèle d'IA avancé. En conséquence, le GPT-4 fait preuve d'une fiabilité, d'une créativité et d'une compétence accrues dans la gestion d'aspects complexes par rapport à sa précédente itération, le GPT-3.5.

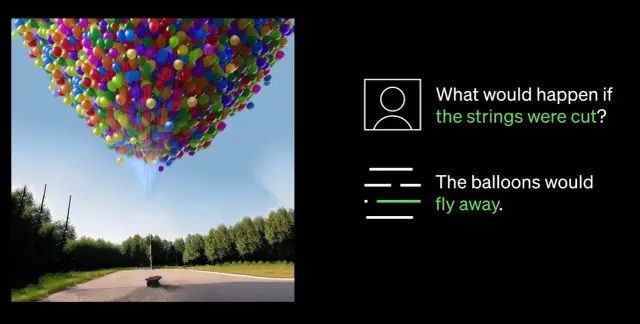

L'une des avancées les plus remarquables de GPT-4 est sa capacité à comprendre à la fois les images et le texte. Par exemple, il peut interpréter et légender des images complexes, comme identifier un adaptateur de câble Lightning en analysant l'image d'un iPhone branché. Cette capacité de compréhension des images est actuellement testée avec le partenaire unique Be My Eyes. Leur nouvelle fonction de bénévolat virtuel alimentée par le GPT-4 aide les utilisateurs à répondre à des questions sur les images, en offrant une analyse complète et des recommandations pratiques basées sur les données de l'image présentées.

L'amélioration de la dirigeabilité constitue une avancée majeure dans les capacités du GPT-4. L'introduction de messages système par le biais de la nouvelle API permet aux développeurs de guider l'IA en fournissant des instructions détaillées sur le style et les tâches. Ces instructions établissent le contexte et les limites des interactions de l'IA, garantissant une relation symbiotique entre l'IA et les ressources humaines.

Malgré des avancées substantielles, l'OpenAI reconnaît que le GPT-4 a des limites, notamment des erreurs de raisonnement, des informations erronées et un manque de connaissance des événements qui se produiront après septembre 2021. En outre, GPT-4 peut introduire par inadvertance des vulnérabilités dans le code qu'il produit. Néanmoins, l'OpenAI a fait des progrès en affinant le GPT-4, le rendant moins susceptible de s'engager dans des contenus interdits ou de répondre de manière inappropriée à des demandes sensibles.

Alors que le domaine de l'IA continue d'évoluer, l'OpenAI reste déterminée à améliorer encore GPT-4, favorisant ainsi un avenir plus intelligent et plus efficace alimenté par une technologie d'IA avancée. Les entreprises qui cherchent à mettre en œuvre l'IA dans leurs flux de travail peuvent envisager d'explorer les plateformes no-code telles que AppMaster.io pour intégrer des systèmes de prise de décision basés sur les données dans leurs activités.