Odkrywanie Auto-GPT: Przyszłość automatyzacji z modelami OpenAI

Auto-GPT wykorzystuje modele SI OpenAI do autonomicznego wykonywania zadań, interakcji z oprogramowaniem i usługami online oraz usprawniania wieloetapowych projektów. To potężne narzędzie oferuje liczne korzyści, ale ma też ograniczenia i ryzyko związane z jego wdrożeniem.

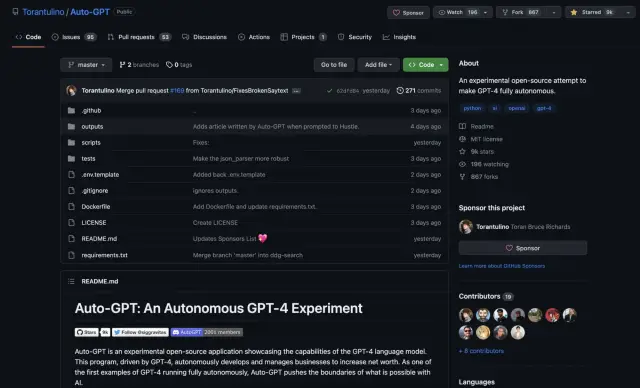

Nieustanne dążenie do automatyzacji w Dolinie Krzemowej doprowadziło do powstania innowacyjnej aplikacji open-source o nazwie Auto-GPT, zapewniającej użytkownikom autonomiczne doświadczenie i wykorzystującej zaawansowane modele AI OpenAI, takie jak GPT-3.5 i GPT-4.

Auto-GPT przyciągnął uwagę w mediach społecznościowych, pokazując swoją zdolność do wykonywania zadań poprzez interakcję z różnymi aplikacjami, oprogramowaniem i usługami, zarówno online, jak i lokalnie. Aplikacja Auto-GPT, stworzona przez twórcę gier Torana Bruce'a Richardsa, osiąga sukces dzięki automatyzacji wieloetapowych projektów, które wymagały serii interakcji z modelami AI zorientowanymi na chatboty, takimi jak ChatGPT firmy OpenAI.

Poprzez połączenie GPT-3.5 i GPT-4 z towarzyszącym botem, Auto-GPT otrzymuje instrukcje od użytkowników, a następnie wykorzystuje kilka programów do osiągnięcia ich celów, znacznie usprawniając proces automatyzacji na różnych platformach.

Twórca oprogramowania Joe Koen, który eksperymentował z Auto-GPT, wyjaśnia, że użytkownicy mogą wprowadzać swoje cele do Auto-GPT, który następnie komunikuje się z API OpenAI. SI generuje odpowiedzi, które prowadzą agenta Auto-GPT przez wymagane polecenia, wykonując zadania bez interwencji użytkownika.

Wszechstronna funkcjonalność Auto-GPT opiera się na takich funkcjach jak zarządzanie pamięcią w celu wykonania zadania oraz GPT-4 i GPT-3.5 w celu generowania tekstu, przechowywania plików i podsumowania. Może nawet połączyć się z syntezatorami mowy, umożliwiając SI na przykład prowadzenie rozmów telefonicznych.

Jednak aby wykorzystać Auto-GPT, użytkownicy muszą zainstalować go w środowisku programistycznym, takim jak Docker, i uzyskać klucz API od OpenAI, co wymaga płatnego konta. Mimo to pierwsi użytkownicy uznali Auto-GPT za nieocenioną pomoc w obsłudze prozaicznych zadań, takich jak debugowanie kodu, pisanie e-maili, a nawet opracowywanie biznesplanów dla nowych startupów.

Adnan Masood, główny architekt w firmie UST, podkreśla, że choć duże modele językowe doskonale radzą sobie z generowaniem odpowiedzi zbliżonych do ludzkich, to jednak wymagają one wejścia użytkownika i interakcji, aby osiągnąć pożądane rezultaty. Z kolei Auto-GPT działa niezależnie, wykorzystując zaawansowane możliwości API OpenAI.

Niedawno pojawiły się nowe aplikacje, takie jak AgentGPT i GodMode, które upraszczają korzystanie z Auto-GPT, udostępniając użytkownikom interfejs za pośrednictwem przeglądarki internetowej. Niemniej jednak, narzędzia te nadal wymagają klucza API z OpenAI dla pełnej funkcjonalności.

Pomimo dużych możliwości, Auto-GPT ma swoje ograniczenia i zagrożenia. Narzędzie może wykazywać nieprzewidywalne zachowanie w zależności od podanych celów. Dodatkowo, jego zależność od modeli językowych OpenAI w zakresie realizacji zadań oznacza, że może on generować nieścisłości i błędy. Ponadto Auto-GPT ma problemy z przypomnieniem sobie wcześniej wykonanych zadań i często nie pamięta, jakich programów użyć do podobnych zadań w przyszłości. Napotyka również trudności w rozbiciu złożonych zadań i zrozumieniu pokrywających się celów.

Clara Shih, dyrektor generalny Salesforce's Service Cloud i entuzjastka Auto-GPT, podkreśla, że dla przedsiębiorstw stosujących generatywne technologie AI, takie jak Auto-GPT, ważne jest zintegrowanie podejścia "człowiek w pętli". Pomaga to złagodzić ryzyko i zmaksymalizować potencjał możliwości Auto-GPT w bezpieczny i efektywny sposób.

W miarę jak krajobraz no-code stale się rozwija, innowacyjne platformy, takie jak AppMaster, oferują rozwiązania, które umożliwiają użytkownikom łatwe tworzenie zaawansowanych aplikacji backendowych, internetowych i mobilnych. Podobnie jak Auto-GPT, AppMaster umożliwia również użytkownikom tworzenie i zarządzanie projektami, przyczyniając się do usprawnienia i zwiększenia wydajności pracy w różnych sektorach.