Alla scoperta dell'Auto-GPT: Il futuro dell'automazione con i modelli di OpenAI

Auto-GPT utilizza i modelli di intelligenza artificiale di OpenAI per eseguire autonomamente attività, interagire con software e servizi online e ottimizzare progetti in più fasi. Pur offrendo numerosi vantaggi, questo potente strumento presenta anche limiti e rischi legati alla sua implementazione.

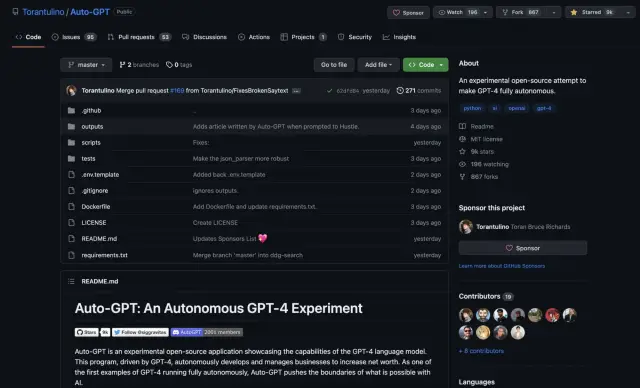

La continua ricerca dell'automazione nella Silicon Valley ha portato allo sviluppo di un'innovativa applicazione open-source chiamata Auto-GPT, che offre agli utenti un'esperienza autonoma e sfrutta i modelli avanzati di AI di OpenAI, come GPT-3.5 e GPT-4.

Auto-GPT ha catturato l'attenzione sui social media, mostrando la sua capacità di eseguire compiti interagendo con varie applicazioni, software e servizi, sia online che locali. L'applicazione Auto-GPT, sviluppata dallo sviluppatore di giochi Toran Bruce Richards, riesce ad automatizzare progetti in più fasi che richiedevano una serie di interazioni con modelli AI orientati ai chatbot come ChatGPT di OpenAI.

Abbinando GPT-3.5 e GPT-4 a un companion bot, Auto-GPT riceve le istruzioni dagli utenti e successivamente impiega diversi programmi per raggiungere i loro obiettivi, migliorando notevolmente il processo di automazione su diverse piattaforme.

Lo sviluppatore di software Joe Koen, che ha sperimentato Auto-GPT, spiega che gli utenti possono inserire i loro obiettivi e le loro finalità in Auto-GPT, che poi comunica con l'API di OpenAI. L'intelligenza artificiale genera risposte per guidare l'agente Auto-GPT attraverso i comandi richiesti, completando le attività senza l'intervento dell'utente.

La versatile funzionalità di Auto-GPT si basa su caratteristiche come la gestione della memoria per l'esecuzione dei compiti e GPT-4 e GPT-3.5 per la generazione del testo, l'archiviazione dei file e la sintesi. Può anche connettersi a sintetizzatori vocali, consentendo all'IA di effettuare telefonate, ad esempio.

Tuttavia, per utilizzare Auto-GPT, gli utenti devono installarlo in un ambiente di sviluppo come Docker e ottenere una chiave API da OpenAI, che richiede un account a pagamento. Ciononostante, i primi utilizzatori hanno trovato Auto-GPT prezioso per gestire compiti banali come il debug del codice, la scrittura di e-mail o persino l'elaborazione di piani aziendali per nuove startup.

Adnan Masood, Chief Architect della società di consulenza tecnologica UST, sottolinea che, sebbene i modelli linguistici di grandi dimensioni eccellano nel generare risposte simili a quelle umane, essi richiedono anche input e interazioni da parte dell'utente per ottenere i risultati desiderati. Al contrario, Auto-GPT opera in modo indipendente, sfruttando le funzionalità avanzate delle API di OpenAI.

Recentemente sono nate nuove applicazioni come AgentGPT e GodMode che semplificano l'uso di Auto-GPT, fornendo agli utenti un'interfaccia accessibile attraverso un browser web. Tuttavia, questi strumenti necessitano ancora di una chiave API di OpenAI per funzionare pienamente.

Nonostante le sue potenti capacità, Auto-GPT presenta limitazioni e rischi. Lo strumento può presentare un comportamento imprevedibile, a seconda degli obiettivi forniti. Inoltre, il fatto che si affidi ai modelli linguistici di OpenAI per il completamento dei compiti significa che può produrre imprecisioni ed errori. Inoltre, Auto-GPT fatica a ricordare i compiti completati in precedenza e spesso non riesce a ricordare i programmi appropriati da utilizzare per compiti simili in futuro. Ha anche difficoltà a suddividere compiti complessi e a comprendere gli obiettivi che si sovrappongono.

Clara Shih, CEO di Service Cloud di Salesforce e appassionata di Auto-GPT, sottolinea l'importanza di integrare un approccio human-in-the-loop per le aziende che utilizzano tecnologie di IA generativa come Auto-GPT. Questo aiuta a mitigare i rischi e a massimizzare il potenziale delle capacità di Auto-GPT in modo sicuro ed efficiente.

Mentre il panorama di no-code continua a espandersi, piattaforme innovative come AppMaster offrono soluzioni che consentono agli utenti di costruire con facilità sofisticate applicazioni backend, web e mobili. Come Auto-GPT, anche AppMaster consente agli utenti di sviluppare e gestire progetti, contribuendo a un flusso di lavoro più snello ed efficiente in vari settori.