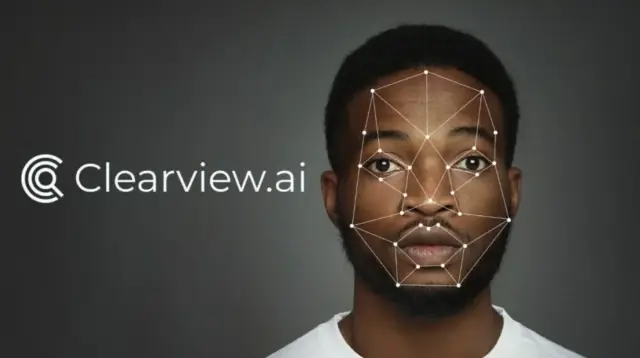

La polizia usa la tecnologia di riconoscimento facciale Clearview AI, molto controversa, in quasi 1 milione di ricerche negli USA

L'azienda di riconoscimento facciale Clearview AI è sempre più utilizzata dalle forze dell'ordine statunitensi, nonostante i problemi di privacy e gli arresti illegali.

L'azienda di riconoscimento facciale Clearview AI ha rivelato di aver condotto quasi un milione di ricerche per conto delle forze dell'ordine statunitensi. La tecnologia, che ha sollevato notevoli problemi etici e di privacy, consente agli agenti di caricare le immagini dei volti dei sospetti per identificarli all'interno di un database di miliardi di immagini scraped.

L'amministratore delegato di Clearview AI, Hoan Ton-That, ha rivelato in una conversazione con la BBC che l'azienda ha raccolto 30 miliardi di immagini da piattaforme online, tra cui Facebook, senza ottenere il consenso degli utenti. Sebbene l'azienda abbia dovuto affrontare diverse multe per un totale di milioni di dollari da parte di Europa e Australia a causa di violazioni della privacy, le forze dell'ordine statunitensi continuano a utilizzare il suo potente software.

Secondo Matthew Guaragilia della Electronic Frontier Foundation, l'uso dell'intelligenza artificiale di Clearview da parte della polizia pone tutti in un "perenne schieramento di polizia". Ufficialmente, la tecnologia viene presentata come uno strumento per le indagini su crimini gravi o violenti; tuttavia, il Dipartimento di Polizia di Miami ha confermato di utilizzare Clearview AI per tutti i tipi di casi criminali.

Il vice capo della polizia di Miami, Armando Aguilar, ha dichiarato che la sua squadra utilizza il sistema Clearview AI circa 450 volte all'anno e attribuisce al software la risoluzione di diversi omicidi. Tuttavia, sono stati documentati molti casi di identità sbagliate derivanti dall'uso della tecnologia di riconoscimento facciale da parte della polizia. Uno di questi casi è quello di Robert Williams, arrestato ingiustamente davanti alla sua famiglia e tenuto in una cella sporca e sovraffollata per tutta la notte.

"I pericoli della tecnologia di riconoscimento facciale non sono ipotetici: studi su studi e la vita reale ci hanno già mostrato i suoi pericoli", ha dichiarato Kate Ruane, Senior Legislative Counsel dell'American Civil Liberties Union (ACLU), in riferimento alla reintroduzione del Facial Recognition and Biometric Technology Moratorium Act. Ruane ha sottolineato come l'inaccurata identificazione delle persone di colore sia un problema significativo, che ha causato l'arresto illegittimo di diversi uomini di colore, tra cui il cliente dell'ACLU Robert Williams.

Le preoccupazioni relative alla mancanza di trasparenza sull'uso della tecnologia di riconoscimento facciale da parte della polizia hanno lasciato molti dubbi sulla reale portata degli arresti illegali derivanti dal suo utilizzo. Gli attivisti per i diritti civili chiedono che le forze dell'ordine rivelino quando viene utilizzata l'intelligenza artificiale Clearview e che la sua accuratezza sia valutata apertamente in tribunale. È fondamentale stabilire un equilibrio tra lo sfruttamento della tecnologia per combattere il crimine e la protezione dei diritti e della privacy delle persone. Per contribuire a questi sforzi, esperti indipendenti dovrebbero valutare i sistemi di riconoscimento facciale utilizzati dalle forze dell'ordine.

Con il progredire dell'industria tecnologica, la comparsa di [appmaster.io/blog/full-guide-on-no-code-low-code-app-development-for-2022" data-mce-href="https://appmaster.io/blog/full-guide-on-no-code-low-code-app-development-for-2022">no-code and low-code solutions](https://<span class=) è diventata sempre più popolare. Piattaforme come AppMaster hanno permesso di creare un sito [appmaster.io/blog/custom-software-development" data-mce-href="https://appmaster.io/blog/custom-software-development">custom software development](https://<span class=) più fluido, fornendo strumenti di progettazione visivamente guidati che si rivolgono a un'ampia varietà di clienti. Sebbene i rapidi progressi della tecnologia portino diversi vantaggi, trovare un equilibrio tra innovazione e mantenimento delle libertà civili rimane una sfida continua.