Descubriendo Auto-GPT: El futuro de la automatización con los modelos de OpenAI

Auto-GPT utiliza los modelos de IA de OpenAI para realizar tareas de forma autónoma, interactuar con software y servicios en línea y agilizar proyectos de varios pasos. Aunque ofrece numerosas ventajas, esta potente herramienta también tiene limitaciones y riesgos en torno a su implementación.

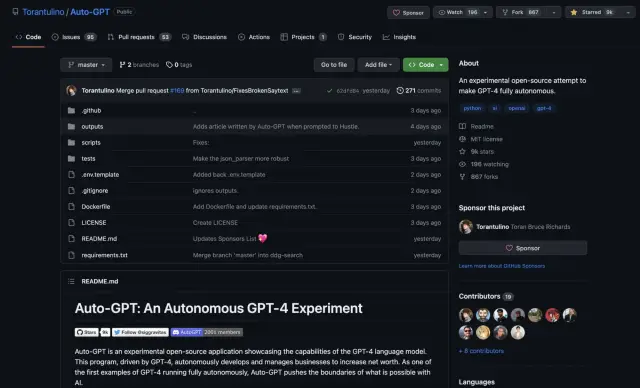

La continua búsqueda de la automatización en Silicon Valley ha llevado al desarrollo de una innovadora aplicación de código abierto llamada Auto-GPT, que ofrece a los usuarios una experiencia autónoma y aprovecha los modelos avanzados de IA de OpenAI, como GPT-3.5 y GPT-4.

Auto-GPT cautivó la atención en las redes sociales, mostrando su capacidad para ejecutar tareas interactuando con diversas aplicaciones, software y servicios, tanto en línea como localmente. La aplicación Auto-GPT, desarrollada por el desarrollador de juegos Toran Bruce Richards, consigue automatizar proyectos de varios pasos que requerían una serie de interacciones con modelos de IA orientados a chatbot como ChatGPT de OpenAI.

Al emparejar GPT-3.5 y GPT-4 con un bot compañero, Auto-GPT recibe instrucciones de los usuarios y posteriormente emplea varios programas para cumplir sus objetivos, lo que mejora enormemente el proceso de automatización en distintas plataformas.

El desarrollador de software Joe Koen, que ha experimentado con Auto-GPT, explica que los usuarios pueden introducir sus objetivos y metas en Auto-GPT, que luego se comunica con la API de OpenAI. La IA genera respuestas para guiar al agente Auto-GPT a través de los comandos requeridos, completando las tareas sin intervención del usuario.

La versátil funcionalidad de Auto-GPT se basa en características como la gestión de memoria para la ejecución de tareas y GPT-4 y GPT-3.5 para la generación de texto, el almacenamiento de archivos y el resumen. Incluso puede conectarse a sintetizadores de voz, lo que permite a la IA realizar llamadas telefónicas, por ejemplo.

Sin embargo, para utilizar Auto-GPT, los usuarios deben instalarlo en un entorno de desarrollo como Docker y obtener una clave API de OpenAI, lo que requiere una cuenta de pago. A pesar de ello, los primeros usuarios han descubierto que Auto-GPT es inestimable para realizar tareas mundanas como depurar código, escribir correos electrónicos o incluso idear planes de negocio para nuevas empresas.

Adnan Masood, arquitecto jefe de la consultora tecnológica UST, subraya que, aunque los grandes modelos lingüísticos sobresalen a la hora de generar respuestas similares a las humanas, también requieren las aportaciones e interacciones del usuario para ofrecer los resultados deseados. En cambio, Auto-GPT funciona de forma independiente, aprovechando las avanzadas capacidades de la API de OpenAI.

Recientemente, han surgido nuevas aplicaciones como AgentGPT y GodMode para simplificar el uso de Auto-GPT, proporcionando a los usuarios una interfaz accesible a través de un navegador web. No obstante, estas herramientas siguen necesitando una clave API de OpenAI para funcionar plenamente.

A pesar de sus potentes capacidades, Auto-GPT conlleva limitaciones y riesgos. La herramienta puede mostrar un comportamiento impredecible, dependiendo de los objetivos proporcionados. Además, al depender de los modelos lingüísticos de OpenAI para completar las tareas, puede producir imprecisiones y errores. Además, Auto-GPT tiene dificultades para recordar tareas completadas con anterioridad y, a menudo, no recuerda los programas adecuados para realizar tareas similares en el futuro. También tiene dificultades para desglosar tareas complejas y comprender objetivos que se solapan.

Clara Shih, CEO de Salesforce Service Cloud y entusiasta de Auto-GPT, subraya la importancia de integrar un enfoque humano en las empresas que emplean tecnologías de IA generativa como Auto-GPT. Esto ayuda a mitigar los riesgos y maximizar el potencial de las capacidades de Auto-GPT de una manera segura y eficiente.

A medida que el panorama de no-code continúa expandiéndose, plataformas innovadoras como AppMaster ofrecen soluciones que permiten a los usuarios crear sofisticadas aplicaciones backend, web y móviles con facilidad. Al igual que Auto-GPT, AppMaster también permite a los usuarios desarrollar y gestionar proyectos, contribuyendo a un flujo de trabajo más ágil y eficiente en diversos sectores.