El ascenso de ChatGPT genera debates sobre el plagio, las alucinaciones y la transparencia en la IA

A medida que ChatGPT de OpenAI gana fuerza, se están desarrollando nuevas herramientas como GPTZero y el verificador de verdad de Got It AI para contrarrestar el plagio y las alucinaciones.

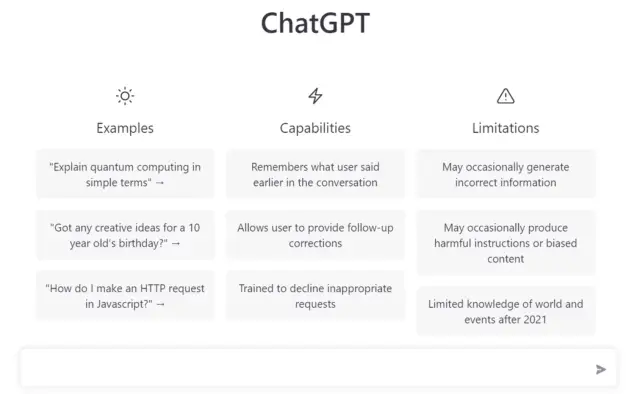

El rápido ascenso de ChatGPT de OpenAI al centro de atención de la IA en solo siete semanas ha elevado las discusiones sobre el potencial de la tecnología para causar plagio, alucinaciones y el impacto posterior en la academia. Como modelo de lenguaje de IA experto en generar respuestas textuales altamente persuasivas, ChatGPT demuestra una capacidad notable para rapear, rimar, resolver problemas matemáticos complejos e incluso escribir código de computadora.

El artículo Stephen Marche's, The College Essay Is Dead, subraya la falta de preparación de la academia sobre cómo la IA transformará el panorama educativo. Sin embargo, ya se han tomado medidas iniciales contra la amenaza de plagio de ChatGPT en los distritos escolares públicos de Seattle y la ciudad de Nueva York. Además, los avances tecnológicos brindan la capacidad de detectar el uso generativo de IA.

Durante el Año Nuevo, el estudiante de informática de la Universidad de Princeton, Edward Tian, desarrolló GPTZero, una aplicación diseñada para detectar de manera eficiente si un fragmento de texto determinado está escrito por ChatGPT o por un ser humano. GPTZero analiza dos características del texto: perplejidad y ráfagas. Tian descubrió que ChatGPT genera textos menos complejos y de mayor duración que la literatura humana.

Si bien no es perfecto, GPTZero muestra resultados prometedores. Tian está en conversaciones con juntas escolares y fondos de becas para proporcionar GPTZeroX a 300 000 escuelas y organismos de financiación. Junto a GPTZero, los desarrolladores están creando herramientas para combatir las alucinaciones, otro problema que surge de la prominencia de ChatGPT.

Peter Relan de Got It AI, una empresa que se especializa en soluciones personalizadas de IA conversacional, destaca que los modelos de lenguaje grandes como ChatGPT inevitablemente producirán alucinaciones. La tasa de alucinaciones de ChatGPT actualmente se encuentra entre el 15 % y el 20 %, pero detectar cuándo el modelo está alucinando conducirá a brindar respuestas más precisas.

La semana pasada, Got It AI anunció una vista previa privada de un nuevo componente de verificación de la verdad de Autonomous Articlebot, que utiliza un gran modelo de lenguaje entrenado para identificar las falsedades contadas por ChatGPT y otros modelos. Este verificador de la verdad actualmente cuenta con una tasa de precisión del 90 %, lo que eleva efectivamente la tasa de precisión general de ChatGPT al 98 %.

Si bien la eliminación completa de las alucinaciones de los sistemas de IA conversacionales no es realista, es plausible minimizar sus ocurrencias. OpenAI, el creador de ChatGPT, aún no ha lanzado una API para el modelo de lenguaje grande. Sin embargo, el modelo subyacente, GPT-3, tiene una API disponible. El verificador de verdad de Got It AI se puede usar con la última versión de GPT-3, davinci-003.

Relan cree que OpenAI abordará la tendencia de la plataforma central a alucinar, con una mejora notable que ya se ha visto en la reducción de la tasa de error de ChatGPT. El desafío principal para OpenAI es disminuir su tasa de alucinaciones con el tiempo.

Con herramientas como GPTZero y el verificador de la verdad de Got It AI, se puede mitigar la amenaza de la IA en el plagio y la alucinación. A medida que se realizan avances en la transparencia y precisión de la IA, plataformas como AppMaster y otras continúan ayudando a acelerar el desarrollo de aplicaciones backend, web y móviles para una amplia gama de usuarios, desde pequeñas empresas hasta grandes empresas.