ChatGPT の台頭が、AI における盗作、幻覚、透明性に関する議論に拍車をかける

OpenAI の ChatGPT が勢いを増すにつれて、GPTZero や Got It AI の真実チェッカーなどの新しいツールが盗作や幻覚に対抗するために開発されています。

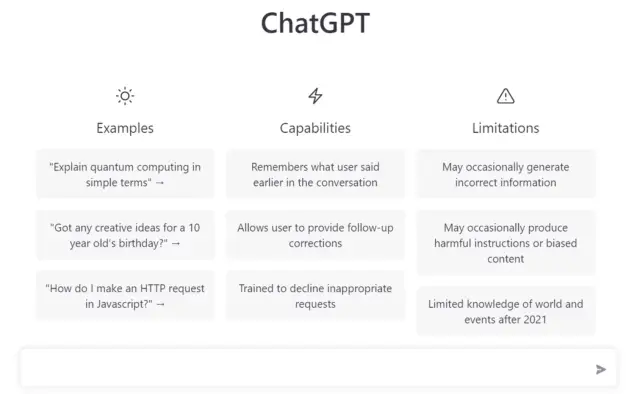

OpenAI の ChatGPT がわずか 7 週間で AI スポットライトに急速に登場したことで、テクノロジーが剽窃や幻覚を引き起こす可能性や、その後の学術界への影響についての議論が高まっています。非常に説得力のあるテキスト応答を生成することに長けた AI 言語モデルとして、ChatGPT は、ラップ、韻を踏む、複雑な数学の問題を解決する、さらにはコンピューター コードを作成する顕著な能力を示しています。

Stephen Marche's記事 The College Essay Is Dead は、 AI が教育環境をどのように変革するかについて学界が準備不足であることを強調しています。ただし、ChatGPT の盗作の脅威に対する最初の措置は、シアトルとニューヨーク市の公立学区ですでに行われています。さらに、技術の進歩により、ジェネレーティブ AI の使用を検出する機能が提供されています。

年末年始、プリンストン大学のコンピューター サイエンス専攻である Edward Tian 氏は GPTZero を開発しました。GPTZero は、特定のテキストが ChatGPT によって書かれたものか人間によって書かれたものかを効率的に検出するように設計されたアプリです。 GPTZero は 2 つのテキスト特性を分析します: 困惑とバースト性です。 Tian は、ChatGPT が生成するテキストは、人間の文献よりも複雑ではなく、一貫して長くなっていることを発見しました。

完全ではありませんが、GPTZero は有望な結果を示しています。 Tian は、GPTZeroX を 300,000 の学校および資金提供機関に提供するために、教育委員会および奨学金基金と話し合っています。 GPTZero と並んで、開発者は、ChatGPT の卓越性から生じる別の問題である幻覚に対抗するためのツールを作成しています。

カスタム会話型 AI ソリューションを専門とする会社、Got It AI の Peter Relan 氏は、ChatGPT のような大規模な言語モデルは必然的に幻覚を生み出すことを強調しています。 ChatGPT の幻覚率は現在 15% から 20% ですが、モデルが幻覚を起こしていることを検出することで、より正確な応答を提供できるようになります。

先週、Got It AI は Autonomous Articlebot の新しい真実チェック コンポーネントのプライベート プレビューを発表しました。このコンポーネントは、ChatGPT やその他のモデルによって語られた嘘を識別するように訓練された大規模な言語モデルを使用します。この真実チェッカーは現在 90% の精度を誇っており、ChatGPT の全体的な精度を実質的に 98% に引き上げています。

会話型 AI システムから幻覚を完全に排除することは非現実的ですが、幻覚の発生を最小限に抑えることはもっともらしいことです。 ChatGPT のメーカーである OpenAI は、大規模言語モデル用の API をまだリリースしていません。ただし、基になるモデルである GPT-3 には使用可能な API があります。 Got It AI の Truth-Checker は、最新の GPT-3 リリースである davinci-003 で使用できます。

Relan 氏は、OpenAI がコア プラットフォームの幻覚傾向に対処し、ChatGPT のエラー率の低下に顕著な改善が見られると考えています。 OpenAI の包括的な課題は、時間の経過とともに幻覚率を低下させることです。

GPTZero や Got It AI のトゥルース チェッカーなどのツールを使用すると、盗作や幻覚における AI の脅威を軽減できる可能性があります。 AI の透明性と精度が向上するにつれて、 AppMasterなどのプラットフォームは、中小企業から大企業まで、幅広いユーザー向けのバックエンド、Web、およびモバイル アプリケーションの開発の加速を支援し続けています。